Attachement et IA chez les étudiants

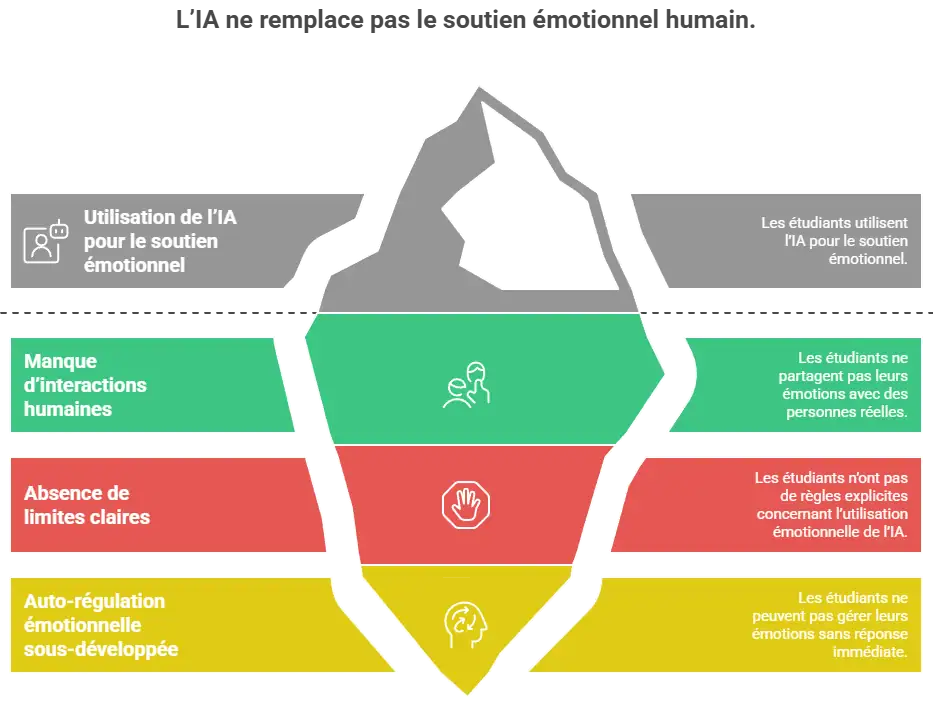

Chez les étudiants, l’autonomie s’accompagne souvent d’isolement ponctuel, de pression académique et de questionnements personnels. L’IA peut offrir une présence constante et une écoute perçue comme neutre. Cette disponibilité peut toutefois influencer la manière dont les étudiants cherchent du soutien émotionnel et gèrent leurs relations, surtout lorsque l’outil devient un interlocuteur privilégié.

Risques

Glissement vers un soutien émotionnel externalisé

L’IA peut être sollicitée pour apaiser le stress, clarifier des doutes personnels ou accompagner des décisions, au détriment d’échanges humains réels.

Installation d’un lien sans réciprocité

La relation avec un système toujours disponible peut renforcer une forme d’attachement unilatéral, sans confrontation, ajustement ni responsabilité partagée.

Retrait relationnel discret

Un usage répété de l’IA comme espace de confidence peut réduire l’initiative de partager ses préoccupations avec des proches ou des pairs.

Symptômes

Préférence pour la confidence numérique

L’étudiant peut choisir l’IA comme premier recours pour parler de ses inquiétudes ou émotions, avant toute interaction humaine.

Difficulté à solliciter un soutien réel

Une hésitation ou une gêne peut apparaître lorsqu’il s’agit de demander de l’aide à une personne de l’entourage.

Attente de disponibilité constante

L’absence de réponse immédiate ou la limitation d’accès à l’outil peut générer un sentiment de manque ou d’inconfort.

Remèdes

Maintenir des espaces d’échange humains intentionnels

Un étudiant ne doit pas laisser l’IA devenir son principal espace de soutien émotionnel.

Les sujets liés :

- au stress

- aux doutes personnels

- aux décisions importantes

- au mal-être

doivent être partagés avec au moins une personne réelle identifiée.

Règle simple à poser (à soi-même) :

“Si c’est important pour moi, je ne le garde pas pour un outil.”

Cadre concret à instaurer :

- identifier une ou deux personnes ressources

- maintenir des échanges réguliers, même courts

- ne pas réserver les discussions difficiles à l’IA

Pourquoi c’est essentiel :

Le soutien émotionnel ne fonctionne que dans une relation où il y a une réponse, un ajustement et une responsabilité mutuelle.

Poser des limites claires à l’usage émotionnel de l’IA

L’IA peut aider à réfléchir, mais ne remplace pas un soutien émotionnel.

Règles explicites :

- l’IA peut aider à formuler une situation

- l’IA peut proposer des pistes générales

- l’IA ne valide pas une émotion personnelle

- l’IA ne remplace pas une discussion humaine

Usage autorisé :

- clarifier ce que l’on ressent

- préparer une discussion difficile

- prendre du recul intellectuel

Usage à éviter :

- chercher du réconfort

- demander une validation affective

- remplacer une relation par un dialogue automatisé

Phrase de régulation personnelle :

“Si j’attends d’être rassuré, ce n’est pas une IA qu’il me faut.”

Développer l’auto-régulation émotionnelle

Un étudiant doit apprendre à traverser certaines émotions sans réponse immédiate.

Cadre à développer :

- accepter un temps d’inconfort

- différer la recherche de réponse

- identifier l’émotion avant de chercher un avis

Règle simple :

“Je fais une pause avant de demander une réponse.”

Pratiques humaines à encourager :

- écrire ce qui nous préoccupe

- en parler à quelqu’un

- s’accorder un temps sans écran

Pourquoi c’est fondamental :

L’autonomie émotionnelle se construit dans la capacité à supporter l’incertitude, pas dans la disponibilité permanente d’une réponse.

L’attachement à l’IA chez les étudiants peut interagir avec d’autres domaines comme la dépendance, la surconfiance ou la manipulation, selon les usages et les contextes.